Η τεχνολογία του voice cloning έχει μεταμορφώσει ριζικά το τοπίο των διαδικτυακών απειλών, εγκαινιάζοντας μια νέα εποχή πρωτοφανούς ψηφιακής εξαπάτησης. Κατά τη διάρκεια της δεκαετίας του 2000, οι απάτες μέσω ηλεκτρονικού ταχυδρομείου είχαν γίνει μια υπερβολικά συνηθισμένη, σχεδόν γραφική καθημερινότητα. Η ψεύτικη υπόσχεση λήψης τεράστιων χρηματικών ποσών, με μοναδική προϋπόθεση την πληρωμή ενός μικρού τέλους μεταφοράς, κυκλοφορούσε ανεξέλεγκτα στο διαδίκτυο και κατάφερε να ξεγελάσει αναρίθμητα, ανυποψίαστα θύματα. Ωστόσο, αυτές οι πρωτόγονες μέθοδοι μοιάζουν πλέον με ένα μακρινό και ξεπερασμένο παρελθόν.

Σήμερα, έχουμε εισέλθει σε μια εντελώς νέα εποχή εξαπάτησης, όπου οι επιθέσεις έχουν γίνει εξαιρετικά περίπλοκες, καθοδηγούμενες αποκλειστικά από τη ραγδαία άνοδο της παραγωγικής τεχνητής νοημοσύνης (generative AI) και των τεχνικών ηχητικής κλωνοποίησης.

Μια πρόσφατη, εκτενής μελέτη που διεξήχθη από την εταιρεία κυβερνοασφάλειας McAfee ανέδειξε με τον πιο εμφατικό τρόπο το πόσο επικίνδυνες και καθημερινές έχουν γίνει αυτές οι επιθέσεις. Σύμφωνα με τα επίσημα στοιχεία της εταιρείας, ένας στους τέσσερις ενήλικες έχει πλέον βιώσει προσωπικά μια απάτη που βασίζεται σε AI ή γνωρίζει τουλάχιστον ένα άτομο από το άμεσο περιβάλλον του που αποτέλεσε στόχο.

📍 Η εξέλιξη της είδησης: VOICE

Οι οικονομικές απώλειες που συνδέονται με αυτές τις καλοστημένες παγίδες είναι εξίσου ανησυχητικές. Για παράδειγμα, το εξειδικευμένο ερευνητικό κέντρο Deloitte Center for Financial Services προβλέπει ότι οι οικονομικές ζημιές από απάτες που προκαλούνται άμεσα από την παραγωγική τεχνητή νοημοσύνη αναμένεται να αυξηθούν κατακόρυφα. Οι εκτιμήσεις κάνουν λόγο για μια εφιαλτική εκτόξευση από τα 12,3 δισεκατομμύρια δολάρια που καταγράφηκαν το 2023, στο ιλιγγιώδες ποσό των 40 δισεκατομμυρίων δολαρίων μέχρι το έτος 2027.

Η ανατομία της κλωνοποίησης φωνής

Ο James Grifo, ένας καταξιωμένος ειδικός σε θέματα ασφάλειας ήχου, ο οποίος κατέχει και επιβλέπει την εταιρεία Audio Visual Nation ως διευθύνων σύμβουλός της, είναι απόλυτα εξοικειωμένος με τις τεχνικές λεπτομέρειες αυτών των επιθέσεων. Μέσα από την πολυετή, επαγγελματική του πορεία, γνωρίζει άριστα τα προφανή – αλλά και τα λιγότερο προφανή – σημάδια που πρέπει να αναζητήσει κανείς όταν υποψιάζεται ότι αποτελεί στόχο μιας τέτοιας επίθεσης, εξηγώντας παράλληλα γιατί αυτός ο τύπος απάτης είναι τόσο καταστροφικός.

Ο Grifo σπεύδει να διευκρινίσει το πόσο τρομακτικά εύκολη έχει γίνει η διαδικασία για τους σύγχρονους απατεώνες. Пλέον, χρειάζονται μόνο μερικά δευτερόλεπτα ηχογραφημένου υλικού από τη φωνή οποιουδήποτε ανθρώπου για να δημιουργήσουν έναν απόλυτα πειστικό, ψηφιακό κλώνο. Αυτό που καθιστά την κλωνοποίηση φωνής ιδιαίτερα αποτελεσματική, όπως σημειώνει ο ίδιος χαρακτηριστικά, είναι το πόσο προσιτή και προσβάσιμη έχει γίνει η τεχνολογία. Οι επιτήδειοι μπορούν πλέον να δημιουργήσουν ένα πειστικό αντίγραφο της φωνής σας χρησιμοποιώντας μόλις τρία δευτερόλεπτα ήχου, τα οποία μπορούν να αντλήσουν πανεύκολα από ένα βίντεο στα κοινωνικά δίκτυα ή ακόμα και από ένα παλιό μήνυμα στον τηλεφωνητή.

Τα σημάδια που προδίδουν την τεχνητή νοημοσύνη

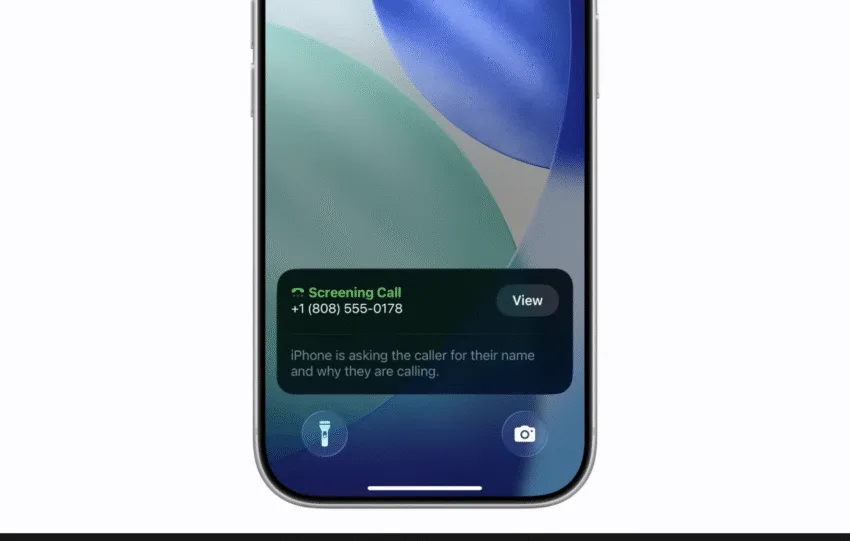

Παρά την τεχνολογική εξέλιξη, υπάρχουν αρκετά χαρακτηριστικά σημάδια που θα πρέπει να κρατούν τους πολίτες σε εγρήγορση, ειδικά όταν το ένστικτό τους προειδοποιεί ότι κάτι δεν πάει καλά με την κλήση που δέχονται. Η αναγνώριση αυτών των ακουστικών ανωμαλιών αποτελεί την πρώτη γραμμή άμυνας.

Αφύσικες παύσεις και έλλειψη ρυθμού. Η ανθρώπινη ομιλία χαρακτηρίζεται από μια φυσική, αβίαστη ροή που περιλαμβάνει μικρούς δισταγμούς και οργανικές αλλαγές στον ρυθμό. Αντίθετα, οι κλωνοποιημένες φωνές συχνά δυσκολεύονται να αναπαράγουν με ακρίβεια τα πρότυπα αναπνοής. Παρατηρούνται συχνά περίεργα, μηχανικά κενά ανάμεσα στις προτάσεις ή ένας ρυθμός που μοιάζει προγραμματισμένος.

Συναισθημα. Ακόμα και όταν το λογισμικό προσπαθεί να μιμηθεί μια κατάσταση ακραίου πανικού, αποτυγχάνει να αποδώσει τις ανεπαίσθητες μικρο-διακυμάνσεις του τόνου που παράγονται από τις ανθρώπινες φωνητικές χορδές υπό συνθήκες πραγματικού στρες. Αν ο συνομιλητής ακούγεται επίπεδος και χωρίς το κατάλληλο συναισθηματικό βάθος για την περίσταση, η κλήση είναι εξαιρετικά ύποπτη.

Αudio artifacts. Κατά τη διάρκεια της κλήσης, τα συστήματα τεχνητής νοημοσύνης αφήνουν συχνά ψηφιακά ίχνη (audio artifacts). Αυτά εκδηλώνονται ως ένας ελαφρώς μεταλλικός αντίλαλος, μικρές ρομποτικές παραμορφώσεις στο παρασκήνιο ή ένας κούφιος ήχος που διαφέρει σημαντικά από τις τυπικές παρεμβολές μιας κακής τηλεφωνικής σύνδεσης.

Η χειραγώγηση και η εξάπλωση στον εταιρικό κόσμο

Οι επιθέσεις αυτές δεν βασίζονται αποκλειστικά στην τεχνολογική τους αρτιότητα, αλλά κυρίως στην ψυχολογική χειραγώγηση του θύματος. Οι εγκληματίες δημιουργούν εσκεμμένα μια αίσθηση αφόρητης πίεσης, ισχυριζόμενοι σχεδόν πάντα ότι βρίσκονται σε μια κρίσιμη, έκτακτη ανάγκη, απαιτώντας άμεση οικονομική βοήθεια προτού ο αποδέκτης της κλήσης προλάβει να ελέγξει τα γεγονότα. Το αίτημα συνοδεύεται συνήθως από την απαίτηση αποστολής χρημάτων μέσω μη ιχνηλάσιμων μεθόδων, όπως τα κρυπτονομίσματα.

Η απειλή, ωστόσο, δεν περιορίζεται στους μεμονωμένους πολίτες. Ο εταιρικός κόσμος αποτελεί έναν εξίσου ελκυστικό στόχο, με τους εγκληματίες να εκμεταλλεύονται το άφθονο ηχητικό υλικό των στελεχών από δημόσιες ομιλίες και συνεντεύξεις. Υποδυόμενοι ανώτερα διευθυντικά στελέχη, δίνουν εντολές σε υπαλλήλους του λογιστηρίου για την άμεση και μυστική μεταφορά τεράστιων χρηματικών ποσών. Το κλειδί για την αντιμετώπιση αυτής της εξελιγμένης μορφής ηλεκτρονικού εγκλήματος, πέρα από τη συνεχή επαγρύπνηση, βρίσκεται στη θέσπιση πρωτοκόλλων επαλήθευσης, όπως η χρήση λέξεων ασφαλείας, τα οποία φέρνουν τον ψηφιακό αλγόριθμο σε απόλυτο αδιέξοδο.